Gemma 4 완전정리 — 성능·설치·활용보다 더 중요한 구글의 진짜 전략

Gemma 4 완전정리 — 성능·설치·활용보다 더 중요한 구글의 진짜 전략

결론부터 드리겠습니다. Gemma 4는 “구글도 오픈모델 하나 더 냈다” 수준의 뉴스가 아닙니다. 구글이 클라우드 안의 AI만이 아니라 기기 안의 AI, 에이전트용 AI, 개발자 생태계용 AI까지 한 번에 다시 장악하려는 신호입니다. 겉으로 보면 모델 출시지만, 전략적으로 보면 플랫폼 경계선을 밖으로 밀어내는 카드에 가깝습니다. 알렙이 구조부터 읽어드립니다.

1Gemma 4 한 줄 요약 — 무엇이 나왔는가

2026년 4월 2일, 구글 DeepMind가 Gemma 4를 공개했습니다. Gemini 3 연구를 기반으로 만든 오픈모델 계열이며, Apache 2.0 라이선스로 완전 공개됐습니다. 월간 사용자 수 제한도, 상업적 사용 제한도 없습니다. Hugging Face 공동창업자 Clément Delangue는 이 라이선스 변경을 두고 “거대한 이정표”라고 평가했습니다.

크기는 4가지입니다. E2B / E4B는 모바일·IoT용 극한 경량 모델이고, 26B A4B는 MoE(Mixture-of-Experts) 아키텍처로 활성 파라미터 3.8B만 쓰는 효율 극대화 모델입니다. 31B Dense는 오픈모델 중 절대 성능 최상위를 노리는 플래그십입니다. E2B·E4B는 스마트폰에서, 26B MoE는 24GB GPU에서, 31B는 단일 H100 80GB에서 실행됩니다.

| 모델 | 파라미터 | 컨텍스트 | 특이사항 | 타깃 하드웨어 |

|---|---|---|---|---|

| E2B | 2.3B (유효) | 128K | 오디오 입력 지원 | 스마트폰·IoT |

| E4B | 4.5B (유효) | 128K | 오디오 입력 지원 | 8GB 랩탑 GPU |

| 26B A4B (MoE) | 26B 총 / 3.8B 활성 | 256K | 추론 속도 최적화 | 24GB GPU (Q4 양자화) |

| 31B Dense | 31B | 256K | Arena AI 오픈모델 3위 | H100 80GB (단일) |

② Dual RoPE — 슬라이딩/전역 레이어에 서로 다른 위치 임베딩 방식을 적용해 256K 컨텍스트에서도 품질 저하 없이 동작합니다.

③ 공유 KV 캐시 — 마지막 N개 레이어가 앞 레이어의 key·value 텐서를 재사용해 추론 메모리·연산 모두 절감합니다.

2구글은 왜 지금 Gemma 4를 냈나 — 알렙의 시각

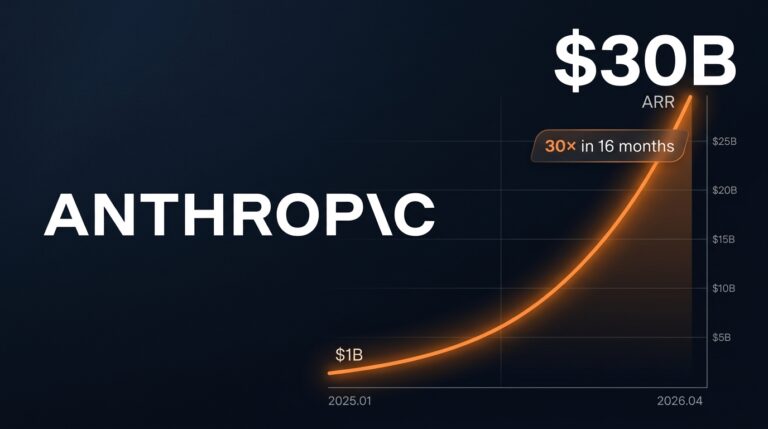

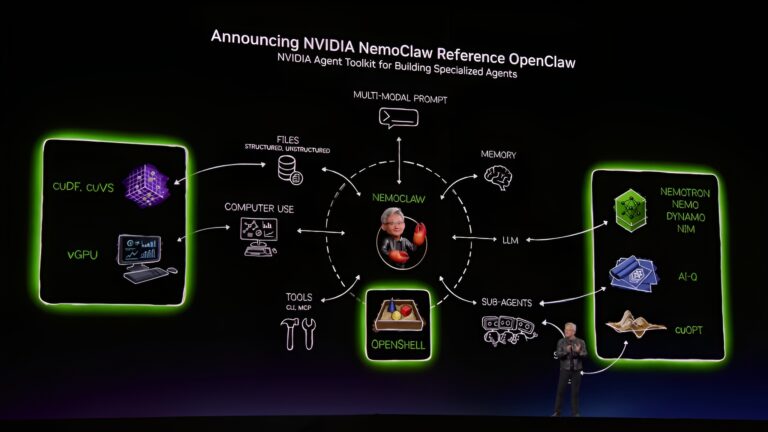

지금 AI 산업의 경쟁 지형을 보면, 각 플레이어가 택한 길이 뚜렷하게 갈라지고 있습니다. OpenAI는 사상 최대 $1,220억 펀딩으로 자본을 쌓고, NVIDIA는 NemoClaw로 에이전트 실행의 운영체제 자리를 노립니다. 알리바바는 Qwen을 오픈웨이트로 풀면서 DingTalk·Taobao 등 자사 생태계와 통합해 클라우드 점유율을 키우고 있습니다.

그 사이에서 구글의 선택은 다릅니다. 자본이나 인프라 독점이 아니라 “가장 넓은 배포면”으로 승부를 걸고 있습니다. DeepMind CEO Demis Hassabis는 Gemma 4를 두고 “각 사이즈 기준 세계 최고의 오픈모델”이라고 했습니다.

Gemma 4는 겉으로 보면 모델 스펙 업그레이드입니다. 실제로는 구글이 AI의 경계선을 클라우드 밖까지 밀어내기 시작했다는 신호입니다. OpenAI가 자본을 쌓고 NVIDIA가 인프라를 장악하는 사이, 구글은 “더 열린 모델 + 더 넓은 배포면”이라는 다른 길을 택한 셈입니다. 이 전략의 성패는 단일 모델 성능이 아니라 생태계 밀도가 결정합니다.

3성능 비교보다 더 중요한 것 — Gemma 4 vs Qwen vs GPT 계열

경쟁 모델과의 비교에서 봐야 할 건 벤치마크 1점 차이가 아닙니다. 누가 어디서, 어떤 방식으로 배포되는가입니다. 오픈소스 진영에서 Qwen 3.5 27B가 GPQA Diamond 85.8%로 31B(85.7%)를 아슬아슬하게 앞서는 건 사실입니다. 하지만 그게 전부가 아닙니다.

| 구분 | Gemma 4 31B | Qwen 3.5 27B | GPT-OSS-120B |

|---|---|---|---|

| 라이선스 | Apache 2.0 (완전 오픈) | Apache 2.0 | 제한적 오픈 |

| 에이전트 | Function calling 네이티브 | Agentic coding 특화 | 컴퓨터 조작(OSWorld) |

| 배포 환경 | 온디바이스 ~ 서버 | 클라우드 API 중심 | 클라우드 API |

| 컨텍스트 | 256K | 128K | 1M |

| AIME 2026 | 89.2% | ~90% 수준 | 76.2% (Reasoning 모드) |

| 생태계 | Google AI Studio · Android | 알리바바 클라우드 · DingTalk | OpenAI 플랫폼 |

Gemma 4는 절대 성능 1위를 노리지 않습니다. “가장 넓은 곳에서 돌아가는 모델”을 노리고 있습니다. Qwen 3.5는 기업 내부 프로세스 통합에 강점이 있고, GPT-OSS는 폐쇄형 frontier 성능에서 차별화됩니다. Gemma 4의 실제 경쟁 우위는 소형 모델 구간에서 더 두드러집니다. E2B·E4B에는 오디오 입력과 128K 컨텍스트를 갖춘 직접적인 경쟁자가 Llama 4나 Qwen 3.5 계열에 없습니다.

Gemma 4는 모델 레이어이고, Claude Code 같은 도구는 애플리케이션/도구 레이어입니다. 층위가 다릅니다. 어떤 모델을 골라도 그 위에 어떤 도구와 워크플로우를 얹느냐가 실제 생산성을 결정합니다. Gemma 4가 뛰어나다고 해서 현재 쓰는 도구 스택을 바로 바꿀 필요는 없습니다.

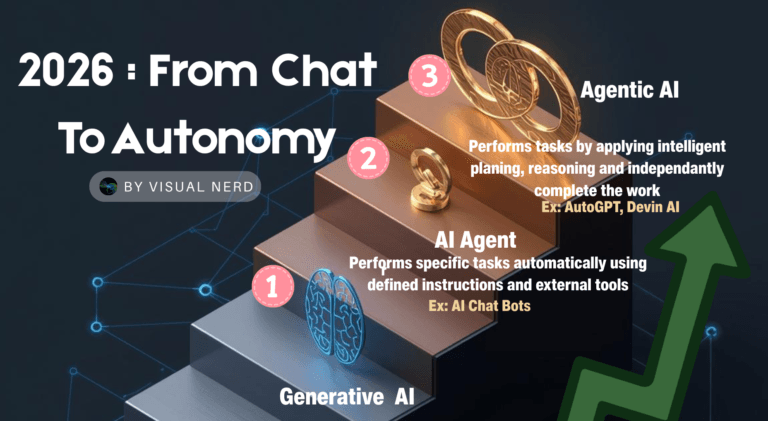

4에이전트 시대의 핵심 — Gemma 4가 노리는 자리

Gemma 4의 설계에서 가장 눈여겨볼 부분은 에이전트 워크플로우 지원입니다. Function calling 네이티브, 구조화된 JSON 출력, 멀티스텝 플래닝, 확장 추론(Extended Thinking) 모드까지 내장됐습니다. UI 요소 감지를 위한 바운딩 박스 출력도 지원해 브라우저 자동화·스크린 파싱 에이전트에도 직접 쓸 수 있습니다.

알렙이 TurboQuant 분석에서 짚었던 흐름, 즉 AI 효율화가 수요를 죽이는 게 아니라 오히려 데이터센터 밖 확산을 가속한다는 관점과 정확히 맞닿아 있습니다. Claude Code 유출 분석에서는 챗봇이 아닌 “상시 실행 에이전트”가 도구 시장의 다음 표준이 되고 있음을 확인했습니다. Gemma 4는 바로 그 두 줄기 — 경량화된 추론과 에이전트 실행 — 이 모델 레이어에서 만나는 지점입니다.

젠슨 황이 말한 에이전트 시대의 폭증하는 추론 수요는 결국 두 갈래로 나뉩니다.

하나는 NVIDIA NemoClaw 같은 중앙집중형 인프라, 다른 하나는 Gemma 4 같은 경량 오픈모델을 통한 분산형 추론입니다.

이 두 길이 경쟁하면서 공존할 때, 투자자가 봐야 할 건 어느 쪽이 이기느냐가 아니라 어느 레이어에 올라탈 것인가입니다.

5누가 지금 당장 써봐야 하나 — 설치와 활용

진입 경로는 생각보다 단순합니다. 브라우저에서 바로 테스트하려면 Google AI Studio, 로컬 실행은 Hugging Face·Kaggle·Ollama, 모바일 앱 통합은 Android Studio AICore 개발자 프리뷰를 활용하면 됩니다.

지금 바로 테스트할 만한 팀

온디바이스·모바일 AI 제품을 만드는 팀 — 지연시간과 개인정보가 중요한 서비스. 사내 보안 이슈로 외부 API 호출 없이 내부 추론이 필요한 조직. 에이전트 워크플로우를 실험 중인 개발팀 — function calling 기반 태스크 오케스트레이션. 비용 통제와 빠른 프로토타이핑이 필요한 스타트업.

아직 서두를 필요 없는 경우

폐쇄형 frontier model의 최고 성능이 꼭 필요한 경우. 컴퓨터 조작형 에이전트(OSWorld 등)가 핵심인 팀. 모델보다 워크플로우·툴 통합이 더 급한 팀이라면 GPT-OSS나 Claude Code 생태계를 먼저 안정화하는 게 맞습니다. 좋은 모델과 이기는 플랫폼은 다른 이야기입니다.

6투자자 관점에서 읽어야 할 3가지 신호

Gemma 4의 성패를 가를 변수는 모델 성능이 아닙니다. 생태계 밀도입니다. 오픈모델에서 화제성과 수익화는 다른 문제입니다. 성능 격차가 좁아도 툴링과 생태계가 약하면 묻힙니다.

결론 — Gemma 4가 던진 진짜 질문

Gemma 4는 “구글도 오픈모델을 한다”는 뉴스가 아닙니다. “구글이 AI의 경계선을 클라우드 밖으로 확장하기 시작했다”는 신호에 가깝습니다.

지금 봐야 할 건 성능이 아니라 배포면입니다. 누가 더 잘 답하느냐가 아니라, 누가 더 많은 기기와 워크플로우에 들어가느냐의 게임입니다. 그리고 그 경계가 넓어질수록, 추론 비용과 인프라 구조, 에이전트 실행 방식, 투자 지도가 같이 바뀝니다.

Gemma 4는 그 변화의 첫 번째 대형 사례입니다. 다음에 봐야 할 것은 실제 채택 속도, Qwen·GPT 계열과의 생태계 전쟁이 어떤 방향으로 전개되는지, 그리고 온디바이스·에이전트 수혜 기업 지도의 변화입니다.

이 글의 모든 수치는 투자 권유가 아닌 정보 제공 목적입니다. 모든 투자 판단과 책임은 본인에게 있으며, 중요한 결정 전 전문 금융 어드바이저 상담을 권고합니다.

📌 이 분석, 도움이 됐나요?

다음 포스트에서는 “에이전트 시대의 추론 인프라 전쟁 — NVIDIA NemoClaw vs 분산형 오픈모델”을 다룰 예정입니다.

댓글로 Gemma 4에 대한 여러분의 생각을 남겨주세요.